Si bien existen muchos estudios, en Optify realizaron uno, en 250 webs, 10.000 palabras claves y más de 1 millón de clicks, los resultados son los siguientes:Los sitios que ocupan las primeras tres posiciones en los resultados de búsqueda, se llevan (en promedio) el 58% de los clicks (visitas).

Estar en primera ubicación, nos premia con el 36,4% de los clicks (nada mal he!), y es el que hace la gran diferencia, pues estar segundo o tercero nos deja el 12,5% o 9,5%, respectivamente.

Finalmente el cuarto puesto nos deja 7,9%, quinto puesto 6,1% y estar ultimo en la primera pagina (es decir el decimo puesto), nos da tan solo un 2,2% de las potenciales visitas que tenga dicha búsqueda.

No dejes escapar esta presentación del Taller Posicionamiento SEO vs. Marketing Programático para colocar tu página web entre las primeras posiciones de los principales motores de búsqueda, promocionando tus productos y servicios al mínimo coste posible.

Completa el formulario y descártate Taller Posicionamiento Natural SEO vs. Marketing Programático

[contact-form-7 id=»14573″ title=»Descargar Taller Posicionamiento Natural SEO»]

Tabla de contenidos

¿Qué tienes que hacer para posicionar tu web?

Los SEO tienden a usar muchas herramientas para la preparación de la página web para el mejor posicionamiento natural. Algunas de las más útiles son proporcionadas por los propios motores de búsqueda, como puede ser Google Analytics o Google Search Console.

Los motores de búsqueda quieren que los webmasters creen sitios y contenido para que todos puedan acceder. Por lo que ofrecen una variedad de herramientas para el análisis y control, atributos y funciones que nos ayudan a mejorar el posicionamiento de nuestra página web, así como conocimiento de muchísimo valor que nos hará la vida del experto en posicionamiento natural mucho más fácil. Si eres uno de ellos o pretender serlo no te pierdas este artículo.

A continuación explicamos los elementos comunes de cada uno de los principales motores de búsqueda.

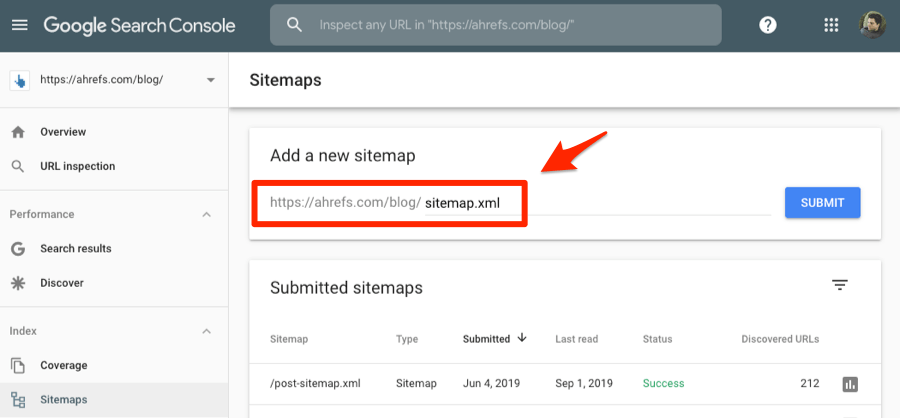

Sitemaps: mapa del sitio

Piense en un mapa del sitio como una lista de archivos que dan pistas a los motores de búsqueda sobre cómo pueden rastrear tu sitio web. Sitemaps ayuda a los motores de búsqueda a encontrar y clasificar el contenido de tu página web ya que pueden no haberlo encontrado por sí mismos.

Los sitemaps pueden encontrase en muy variados formatos y pueden destacar muchos tipos de contenido: video, imágenes, noticias …Puedes leer todos los detalles en Sitemaps.org. Además, puedes construir tus propios mapas de sitio en XML-Sitemaps.com. Los sitemaps pueden ser de alguna de estos tres tipos:

XML Lenguaje de marcado extensible (formato recomendado)

Este es el formato más aceptado para los sitemaps. Es extremadamente fácil de analizar para los motores de búsqueda y puede crearse por una gran cantidad de generadores de mapas de sitio. Además, permite el control más detallado de los parámetros de la página.

Debemos tener en cuenta que estos archivos pueden ser relativamente grande. Como un archivo tipo XML requiere una etiqueta de abertura y una etiqueta de cierre para de cada elemento, los tamaños de los archivos pueden ser muy grandes.

RSS Really Simple Syndication o Rich Site Summary

Sobre todo es fácil de mantener. Los mapas de sitio RSS se pueden codificar fácilmente para actualizarse automáticamente cuando se agrega contenido nuevo.

Aunque es más difícil de administrar. Aunque RSS es un archivo XML, en realidad es mucho más difícil de administrar debido a todas sus propiedades que se deben actualizar.

TXT Archivo de texto

Extremadamente facil de crear y modificar. El formato de mapa de sitio de texto es una URL por línea de hasta 50,000 líneas. Aunque la pega es que no proporciona la capacidad de agregar metadatos a las páginas.

Robots.txt: da instrucciones a los rastreadores

El archivo robots.txt, un producto del Robots Exclusion Protocol, es un archivo almacenado en el directorio raíz de un sitio web (por ejemplo, www.google.com/robots.txt). El archivo robots.txt da instrucciones a los rastreadores de los buscadores que visitan tu página web.

Al usar robots.txt, los webmasters pueden indicar a los motores de búsqueda qué áreas de un sitio les gustaría impedir que los bots rastrearan, así como también indicar las ubicaciones de los archivos del mapa del sitio. Puedes leer más detalles sobre esto en la página del Centro de Conocimientos de robots.txt.

Los siguientes comandos están disponibles:

- Rechazar: impide que los robots compatibles accedan a páginas o carpetas específicas.

- Mapa del sitio: indica la ubicación del mapa del sitio web o de los mapas de sitio.

- Retardo de rastreo: indica la velocidad (en segundos) a la que un robot puede rastrear un servidor.

Meta Robots

La etiqueta de meta robots crea instrucciones a nivel de página para los robots de los motores de búsqueda.

La etiqueta meta robots debe incluirse en la sección principal del documento HTML.

4. Rel = «Nofollow»

¿Recuerdas cómo los enlaces actúan como votos ? El atributo rel = nofollow le permite vincular a un recurso, mientras elimina su «voto» para fines del motor de búsqueda. Literalmente, «nofollow» le dice a los motores de búsqueda que no sigan el enlace, aunque algunos motores todavía los siguen para descubrir páginas nuevas. Estos enlaces sin duda tienen menos valor, pero son útiles en diversas situaciones en las que se vincula a una fuente que no es de confianza.

5. Rel = «canónico»

A menudo, dos o más copias del mismo contenido aparecen en tu sitio web bajo diferentes URL. Por ejemplo, las siguientes URL pueden referirse a una sola página de inicio:

- http://www.example.com/

- http://www.example.com/default.asp

- http://example.com/

- http://example.com/default.asp

- http://Example.com/Default.asp

Para los motores de búsqueda, estos aparecen como cinco páginas separadas. Debido a que el contenido es idéntico en cada página, esto puede provocar que los motores de búsqueda devalúen el contenido y su posible posicionamiento.

La etiqueta canónica soluciona este problema al indicarle a los robots de búsqueda qué página es la única y autorizada versión que debe contar en los resultados web.